ChatGPTで質問内容はバレる?情報漏洩の危険性と安全な使い方【2025年版】

ChatGPTに質問した内容は、もしかして「誰かに見られている」かもしれない――。

そんな不安を感じたことはありませんか?

特に近年は「学校でバレた」「会社で使ったら怒られた」「内容が漏れると危ない」など、ChatGPTを使うこと自体にリスクを感じる声も増えています。

実際、質問内容の履歴が保存される仕組みや、生成AIの使用を見抜くツールの存在など、知らないと誤解しやすいポイントも少なくありません。

この記事では、ChatGPTに関する「バレる・漏れる」の真偽から、情報漏洩リスクの具体例、そして安全に使うための実践的な設定や対策まで、2025年最新の情報をもとに解説します。

- 📌ChatGPTでの質問内容が“バレる”仕組みとリスクをわかりやすく解説

- 📌実際の情報漏洩トラブルや学校・企業での禁止事例を紹介

- 📌「バレるサイト」「AI検出ツール」の正体と精度を徹底検証

- 📌安心して使うための履歴設定・個人情報管理の具体策を提示

Contents

ChatGPTで「質問内容がバレる」の真相とは?

本当にバレるの?質問内容は誰かに見られているのか?

ChatGPTに入力した質問が「バレる」「誰かに見られている」と感じる人は少なくありません。

ですが、通常の利用においては個別の質問内容が他人に公開されたり、第三者にリアルタイムで監視されるようなことは基本的にありません。

ただし、これは「OpenAI社のプライバシーポリシーに同意し、利用者としての責任ある使い方をしている場合」に限ります。

以下、仕組みと注意点を詳しく見ていきましょう。

ChatGPTに入力した内容はどう扱われる?

| 処理内容 | 概要 | 関連性 |

|---|---|---|

| 入力データの保存 | 一部データはAIの改善目的で保存される | 初期設定では保存対象になる場合がある |

| 個人情報の明示 | 氏名・住所などを入力した場合、記録対象になる可能性 | プライバシー侵害リスクが生じる可能性あり |

| 公開・共有 | 他ユーザーとの共有機能は存在しない | 「バレる」は基本的に誤解 |

✅ ChatGPT上でのやり取りは、自分以外の一般ユーザーに見られることはありません。ただし、利用者が自発的にスクリーンショットをSNSなどで共有すれば当然“バレる”ことになります。

【事実】企業内・教育機関では監視されるケースもある

たとえば以下のような環境では、「バレる」と言われる背景に一定の根拠があります。

-

企業PCからの利用:ログがIT管理者に残る可能性

-

学校タブレットでの利用:監視アプリや利用制限が設定されている場合

-

Chrome拡張などの記録系ツール:履歴を勝手に保存・送信している場合あり

こうした例では、ChatGPT自体が情報を漏らすのではなく、「端末の使い方」が問題なのです。

✅ 安心ポイントと注意点

| 安心できる点 | 注意が必要な点 |

|---|---|

| OpenAI社は米国企業でGDPRやCCPAなどの基準に準拠 | 無料版の利用でも規約に同意している限り情報は守られる |

| ユーザーのプロンプトは一般に公開されない | 個人情報や機密情報は絶対に入力しない |

OpenAIのデータ利用ポリシーを確認しよう【2025年最新版】

ChatGPTの運営元であるOpenAI社は、公式にユーザーデータの取り扱い方針(プライバシーポリシー)を公表しています。

2025年時点での最新方針を把握しておくことは、「質問内容がバレるのでは?」という不安を払拭するためにも非常に重要です。

OpenAIが明言しているポイント(2025年6月時点)

| ポリシー項目 | 内容 |

|---|---|

| 利用データの記録 | チャット内容の一部は、AI改善の目的で収集される場合がある |

| モデルの学習 | ChatGPT(無料版/Pro版)でのやり取りは今後の学習に使用される可能性あり(※設定変更可能) |

| 個人情報の扱い | 氏名や住所など、個人を特定できる情報の入力は推奨されていない |

| 共有・公開の可否 | 入力内容は外部に自動的に公開されることはない |

| 商用利用との区分 | API経由の利用(有料版など)ではデータが保存されない設定が可能(※法人向け含む) |

🔗 参考:OpenAI Privacy Policy(https://openai.com/policies/privacy-policy)

【注意】2023年以降の変更点で多い誤解とは?

-

以前は「ChatGPTで入力した情報は学習に使われない」とされていましたが、2023年以降は一部例外あり。

-

現在は「設定画面から“カスタムインストラクション”と“会話履歴の保存”をオフにする」ことで、入力内容が学習に使用されなくなります。

🔒 入力内容を守るための2つの対策

-

履歴オフ設定を必ず確認

設定 > データ管理 > 「会話履歴 & トレーニング」→ OFF にする -

絶対に個人情報を入力しない

・実名

・自宅住所

・勤め先名などは記述しないことが大前提です。

「バレる」と感じる瞬間|事例から見る誤解と現実

「もしかしてバレてる…?」

ChatGPTを使っていて、そんな不安にかられた経験がある人は意外と多いものです。しかし、多くの“バレる”体験は、事実誤認や誤解に起因しています。

📌「バレた」と感じやすい3つのケース

| シチュエーション | 実際に起こっていること | 誤解のポイント |

|---|---|---|

| ① ChatGPTが“予想以上に的確”な返答をした | AIが事前学習済みの情報に基づいて推論している | 自分の過去ログを見ていると勘違い |

| ② 他人の投稿と似た回答が表示された | 人気の質問やパターン化されたやり取りがある | 「自分の質問が漏れている」と誤解 |

| ③ ChatGPTからの返信が“以前の自分の質問”に似ている | よくある会話パターンを踏襲しているだけ | 個人情報の再利用ではない |

✅ 実際に「漏洩」しているわけではない

-

ChatGPTはあくまで言語パターンを学習したモデルであり、個別のユーザーIDや履歴から“特定”することはありません。

-

「他人に会話がバレる」「SNSに流出した」というケースの多くは、ユーザー自身が情報を流してしまったか、使用環境のセキュリティ不足によるものです。

❗ ChatGPTが“バレるツール”として使われることはある?

SNSや匿名掲示板で話題になる「バレるサイト」「課題の不正利用チェッカー」の中には、ChatGPTの回答文をAI検出ツールで分析しているだけのものもあります。

つまり、

「ChatGPTに聞いた=バレた」のではなく、AIらしい文章を使ったことが検出されているというだけ。

そのため、入力内容そのものが漏れているわけではありません。

高校や学校での利用制限と「バレた」ケースの背景

ChatGPTを学校で使って「バレた」「怒られた」といった話がSNSなどで出回っていますが、実際に何が起きているのかを正確に知ることが大切です。

📌 学校でのChatGPT利用が制限される背景

学校現場での制限は「ChatGPTが危険だから」ではなく、以下のような教育的配慮によるものです。

| 制限の理由 | 内容 |

|---|---|

| カンニング・不正防止 | 課題やレポートにAIを使うことによる“学習効果の低下”を懸念 |

| 倫理・著作権の理解不足 | 引用やAIの使い方に関する教育が未整備 |

| 利用ガイドライン未整備 | 生徒にどう使わせるかが定まっていない学校が多い |

🧭「バレた」と言われる実際のケース

実際の「バレた」事例は、ChatGPTの中身が見られているのではなく、使い方や表現から教師が気づいたというものが大半です。

✅ よくある“バレ方”の例

-

回答が不自然に流暢すぎて「AIっぽい」と疑われる

-

他の生徒と文体や語彙が酷似していて調査された

-

教師がAI検出ツールを使用してチェックした

📝 参考:教育現場では「GPTZero」などのAI検出ツールが一部導入されています。

❗ChatGPTを学校で使っても違法ではない

誤解されがちですが、ChatGPTを使うこと自体に違法性はありません。問題になるのは以下のような行為です:

-

指定された“自分の考察”にAI回答をそのまま提出

-

AI生成文を自分の言葉として装うこと(≒盗用)

正しい使い方であれば、アイデア補助・要点整理などの“学習支援”ツールとして有効です。

👉実際に、ChatGPTの効果的な使い方や質問の仕方については、 ChatGPTはプログラミング学習に使えない?初心者のための質問の仕方と活用法で詳しく解説しています。

チャット履歴は残る?どこにどう保存されているのか

「ChatGPTで入力した質問内容はどこかに残っているの?」という不安は、実際に多くのユーザーが抱くポイントです。

履歴の扱いを正しく理解することで、過度な不安や誤解を避けられます。

🔍 ユーザー側の「履歴」はブラウザ内に残る

まず、ChatGPTのチャット履歴は基本的にOpenAIのアカウント単位で保存されます。

ログイン状態で利用していれば、過去のやり取りが左側のサイドバーに表示されるのを見たことがあるはずです。

| 保存される場所 | 概要 |

|---|---|

| ユーザーのアカウント | 会話履歴がクラウド上で保存される(手動削除可能) |

| ブラウザのローカルキャッシュ | 履歴一覧やセッション情報が一時的に保存されることも |

📝 履歴は自分の操作で削除可能ですが、完全な削除反映には時間がかかる場合があります。

🧠 OpenAI側のデータ保存はどうなっている?

OpenAIは利用規約において、「品質改善」の目的で一部のやりとりを保存・閲覧することがあると明言しています。

-

2025年現在、「チャット履歴を無効化する」オプションが提供されており、これをOFFにすればOpenAI側の保存対象から除外されます(学習にも利用されません)。

-

ただし、履歴を無効にしても、一時的にログは保存される可能性があるため、完全な匿名性を保証するものではありません。

✅ 詳細は OpenAI のプライバシーポリシー(https://openai.com/policies/privacy-policy)で公開されています。

🛡 安全に使うために知っておくべきこと

-

個人情報や機密情報は入力しないのが原則

-

履歴管理設定で「履歴を無効化」に設定する(Settings → Data Controls)

-

会話内容を外部に公開しないように意識する(特に学校・企業利用)

「バレるサイト」がある?生成AI判定ツールの精度と仕組み

ChatGPTで作成した文章が「AIによる生成かどうか」を判定するサイトが話題になっています。

実際に「バレるサイト」「AI判定ツール」と呼ばれるサービスは複数存在しますが、その精度や仕組みには限界があることを知っておく必要があります。

🧭 「バレるサイト」って何をしているの?

いわゆる「バレるサイト」とは、以下のようなAI判定ツールを指します。

| サービス名 | 特徴 |

|---|---|

| GPTZero | テキストの複雑性・予測性からAI文章を検出 |

| ZeroGPT | 文のパターンをAI学習モデルと照合 |

| AI Content Detector (Originality.aiなど) | 商用利用向け。マーケティング記事などで活用 |

これらのツールは、主に以下のような数値的指標に基づいてAI判定を行います。

-

Perplexity(困惑度):どれだけ人間らしい複雑さがあるか

-

Burstiness(ばらつき):文の長さやトーンの変化

🎯 判定の精度は「100%確実」ではない

実際には、多くの検出ツールで誤判定(False Positive/False Negative)が報告されています。

-

人間が書いた文章でもAIと判定されるケース

-

ChatGPTが作った文章でも人間と判定されるケース

特に2024年以降、GPT-4やClaude 3などの高性能モデルの登場で精度が向上し、文章が“人間らしく”なった結果、識別はますます困難になっています。

🔒 「判定ツールにバレた」=OpenAIに情報が漏れた、ではない

誤解しやすいのが、「AI判定ツールでバレた=OpenAIにログが漏れている」という思い込みです。

実際には、AI判定ツールはChatGPTの履歴とは無関係であり、ChatGPTで生成した文章をツールに自分で貼り付けた時点で検出されるだけです。つまり、ツールに文章を入力しなければ「バレる」ことはありません。

🔑 誤判定に備えて「ハイブリッド執筆」も選択肢

もし教育現場や職場でAI使用が制限されているなら、以下のような対策も有効です。

-

自分の考えを加えた「ハイブリッド」な文書を作る

-

推敲・校正を人間の視点で丁寧に行う

-

判定ツールへの提出を求められる場合は事前に自己チェックする

個人情報をうっかり入力したときのリスクと対応策

ChatGPTに対して、うっかり本名や電話番号、クレジットカード番号などの個人情報を入力してしまった場合、どのようなリスクがあるのでしょうか?

また、その場合に取るべき対応策についても詳しく見ていきます。

🛑 入力された個人情報は記録・学習される可能性がある?

OpenAIは公式に「個人情報は入力しないように」と明言しています。

-

入力されたデータはOpenAIのモデル改善のために利用される可能性があります(※無料版・デフォルト設定時)。

-

そのため、チャットに含まれた個人情報が社内で分析対象になるリスクもゼロではありません。

特に、無料版ChatGPT(GPT-3.5)ではデータ利用の同意設定が自動ONとなっているため、情報が学習データとして利用される場合があります。

🔐 有料版(ChatGPT Plus)や「カスタム設定」でリスクを軽減

情報漏洩のリスクを減らすには、以下の設定変更が有効です:

| 対策内容 | 方法 |

|---|---|

| チャット履歴をオフ | 左下の「設定」>「データ制御」から無効に |

| カスタム設定を使う | API利用やChatGPT Team/Enterprise版では学習対象外設定が可能 |

| GPTs利用時のデータ送信設定 | プライバシーポリシーに準じて設定可能(※GPTs開発者は要注意) |

⚠ もし入力してしまったら?やるべきことリスト

以下のような個人情報を入力した場合、速やかに次の対処を行いましょう。

| 入力した内容 | 対応策 |

|---|---|

| 名前・住所・電話番号 | 履歴削除・サポートに削除依頼を出す |

| クレジットカード番号などの重要情報 | カード会社へ連絡・再発行手続きも検討 |

| 顧客データや社内情報 | 所属組織の情報セキュリティ窓口に報告・再発防止策を徹底 |

✅ ChatGPT側への削除依頼方法

OpenAIは、「データ削除リクエスト」フォームを公開しています。

-

必要に応じて該当チャットID・メールアドレスを記入し送信

※日本語対応はやや限定的ですが、英語での送信が可能です。

ChatGPTの「情報漏洩リスク」と安全に使う方法

企業・エンジニア視点|情報漏洩が問題になるシーンとは?

一般ユーザーだけでなく、企業やエンジニアがChatGPTを使う際にも情報漏洩リスクは大きな懸念材料です。

ここでは、業務での利用時に「問題になるケース」を具体的に見ていきましょう。

💼 企業で問題になる典型例

以下のような「無意識の入力」が、情報漏洩と見なされる原因になります。

| シーン | リスク内容 |

|---|---|

| 顧客データの入力 | 氏名・住所・注文履歴などの個人情報をChatGPTに入力 |

| 社内資料の貼り付け | 非公開のマニュアルや契約書をコピペして要約依頼 |

| ソースコード共有 | 社外秘のプログラムコードやAPIキーの漏洩可能性 |

| 業務課題の相談 | 上司の発言、トラブル事例などの内部情報の開示 |

特に大企業では、「知らぬ間に社員が使っていた」というシャドーIT化が問題になることもあります。

👨💻 エンジニア・開発現場でのリスク

エンジニアがChatGPTを使って以下のような相談をするケースもあります。

-

未公開プロジェクトの技術構成を説明してレビュー依頼

-

認証情報を含むコードを貼ってデバッグ依頼

-

開発中のアルゴリズムを共有して最適化を要請

これらは一見“便利な使い方”に見えますが、社外との無許可なデータ共有と見なされ、重大な情報管理違反につながる可能性があります。

📢 実際に起きた「社内禁止」事例

-

Samsung(サムスン):エンジニアがソースコードをChatGPTに入力 → 機密情報流出の可能性が浮上し、全社で使用禁止に。

-

三菱UFJ銀行グループ:ChatGPT使用時のガイドラインを策定。入力内容の制限を明確化。

このように、多くの企業がChatGPTの使用を全面禁止または制限付きにしているのが現実です。

✅ 対策の方向性

企業やエンジニアがChatGPTを活用するには、以下のようなルール整備と技術対策が必要です:

-

利用ポリシーの整備(入力禁止情報の明示)

-

利用履歴の監視・ログ保存

-

Enterprise版・Team版などの管理機能付きプランの導入

-

API利用時のプロキシ制御やマスキング処理の導入

プログラミング質問で守るべき3つのルール

ChatGPTを使ってプログラミングの質問をする際には、情報漏洩やトラブルを防ぐための「最低限のルール」があります。

ここでは、初心者でもすぐ実践できる3つの基本ルールを解説します。

🛡️ ルール1:個人情報・社内情報は絶対に入力しない

まず大前提として、以下のような情報は絶対に入力しないことが重要です。

-

氏名、住所、電話番号、メールアドレス

-

所属企業名、プロジェクト名

-

社内資料・報告書の内容

-

未公開の仕様書やコード、アルゴリズム

こうした情報を意図せず入力してしまうと、OpenAI側のデータ利用ポリシーにより学習データとして保存・活用される可能性がある(※有料版でも初期設定ではオプトイン)ため、取り返しがつかないこともあります。

⚙️ ルール2:具体的なエラー内容やコードは“切り抜き”で聞く

プログラミングでChatGPTに質問する場合、丸ごと全部コピペはNGです。

特に以下のような「一部抜粋」が望ましい例です:

| NG例 | OK例 |

|---|---|

| 業務システム全体のコードをコピペ | エラーが出ている関数部分のみ貼り付け |

| APIキー付きの設定ファイルを共有 | API部分はダミーに書き換える |

| 自社特有の変数名や設計思想を含むコード | 汎用的な表現に変更して投稿 |

質問の際は、「再現できる最小構成」に切り取るのが開発者の基本姿勢です。

🧠 ルール3:「何が知りたいのか」を明確にする

ChatGPTに限らず、プログラミング質問では「聞き方」次第で精度が大きく変わります。

以下のように、目的を明確に伝える工夫が有効です。

悪い例:

Pythonで動かないんですけど、なんででしょう?

良い例:

Pythonでスクレイピングを試しています。requestsでアクセスすると403が返ってきます。原因と対策を知りたいです。

この3つのルールを守るだけで、「バレる・危ない」といった不安を最小限に抑えつつ、より精度の高い回答を得られる環境が整います。

学生が使うときの注意点|使い方で評価が分かれる

学生がChatGPTを使う際には、「便利すぎる」からこそ誤解やトラブルを招きやすいという現実があります。

「ChatGPTの使用=不正」と見なす学校もあれば、「学習支援ツール」として容認する教育機関もあり、評価が大きく分かれるのが実情です。

✅ 使い方次第で「成績にプラス」になることも

たとえば以下のような使い方は、教育的にも肯定的に捉えられるケースが増えています:

-

難しい用語や概念をかみ砕いて説明してもらう

-

プログラミングのエラー原因をヒントとして探る

-

英作文の構文や文法ミスを添削してもらう

「自分で考え、理解を深める補助ツールとして使っている」ことが明確であれば、評価される傾向にあります。

❌ 丸写しはリスク大|生成AI判定ツールに検出される可能性も

一方で、以下のような使い方は注意が必要です:

-

レポートの全文をChatGPTに生成させて提出

-

宿題や課題の“答え”だけをAIに出させる

-

他人の提出物との類似度が高くなるような構成

これらは「不正使用」と判定されるリスクが高く、近年は大学や高校でも「生成AI検出ツール(AIコンテンツ判定)」を導入する学校が増えています。

学校名を挙げた具体的な導入事例はまだ少ないものの、以下のような動きがあります:

| 導入状況 | 概要 |

|---|---|

| 大学 | ChatGPTで作成された文章をTurnitinやGPTZeroでチェック |

| 高校 | 「生成AIを使った場合は必ず申告」などのルール化 |

| 教育委員会 | 独自にガイドラインを策定・配布する例も |

🎓「使っていい」ではなく「どう使うか」が問われる時代

学校側が本当に見ているのは、ChatGPTを使ったかどうかではなく、使い方が学びに繋がっているかです。

AIを「カンニングツール」ではなく「思考の補助輪」として位置づけ、自分の言葉に落とし込めているかが、今後ますます重要になるでしょう。

「内容が外部に漏れる」リスクをゼロにする使い方とは?

ChatGPTを使う際、多くの人が心配するのが「会話内容が外部に漏れるのではないか?」というリスク。

ですが、このリスクはユーザー側の設定と使い方次第で大きく軽減、あるいは実質ゼロに近づけることができます。

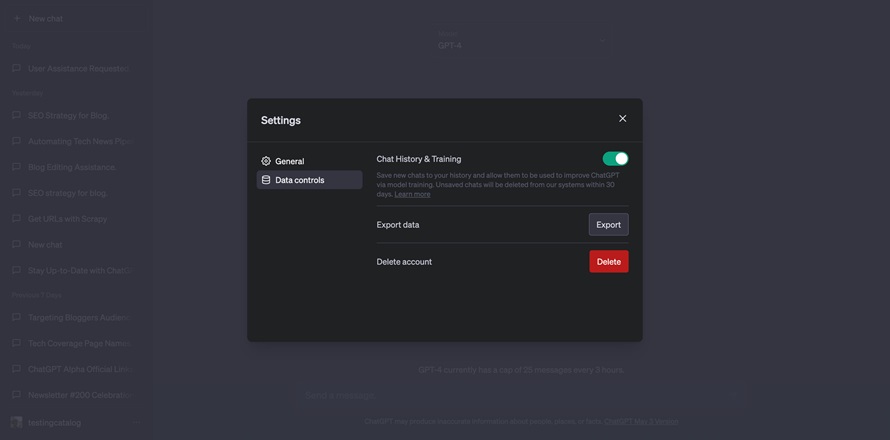

✅ OpenAIの「会話履歴保存」設定をオフにする

ChatGPTには、会話内容をOpenAIの学習データとして使用するかどうかを選べる設定があります。

以下の手順で「履歴保存」をオフにすることで、内容がAIの学習に使われることを防げます:

-

ChatGPTの右下にある「設定(Settings)」をクリック

-

「Data Controls(データ制御)」タブを選択

-

「Chat history & training」をオフにする

-

画面に「この設定では会話は保存されません」と表示されることを確認

この設定を行えば、入力した内容がOpenAIの学習データとして使われることはなくなり、セキュリティ面の不安は大きく軽減されます。

✅ 個人情報・機密情報は「入力しない」が大原則

どんな設定をしていても、機密情報や個人情報は絶対に入力しないことが前提です。

入力してはいけない情報の例:

-

氏名・住所・電話番号などの個人特定情報

-

社外秘のプロジェクト名や開発中のコード

-

パスワードやアクセスキー

-

顧客の個人情報

これらをうっかり入力すると、たとえ履歴が保存されていなくてもブラウザやPCに残る可能性もあり、情報漏洩のリスクが発生します。

✅ セキュリティ強化のために知っておくべきポイント

| セキュリティ対策 | 内容 |

|---|---|

| VPNを活用 | 公共Wi-Fiでの使用時はVPNを通すと安全性が高まる |

| プライベートウィンドウ | ブラウザの履歴を残さず使えるため安全性が増す |

| ログアウトの徹底 | 共有端末での使用後は必ずログアウトする |

🔒 企業や学校でも活用できる「ビジネス版ChatGPT」

機密性の高い業務や教育機関での利用には、OpenAIが提供する「ChatGPT Team / Enterprise」といった有料プランを検討するのもひとつの選択肢です。

これらは以下のような機能を備えています:

-

入力情報は学習に一切使用されない(保証付き)

-

SSOや監査ログ、データ暗号化などセキュリティ対応が強化

-

エンタープライズ利用を前提とした管理機能

ChatGPTの安全な設定・ログ管理の方法【画像あり】

ChatGPTを安全に使うには、初期設定を確認し、ログ(履歴)管理の方法を知っておくことが大切です。

以下の手順で、セキュリティを高めた状態で安心して活用できます。

✅ 「会話履歴と学習利用」をオフにする設定手順

OpenAI公式のChatGPTには、ユーザーの入力内容を学習に使うか否かを切り替えられる設定があります。

【設定画面:例(2025年版UI)】

※画像引用元:OpenAI公式サポート

手順:

-

ChatGPT画面左下の「・・・」→「Settings(設定)」をクリック

-

「Data Controls(データ制御)」タブを開く

-

「Chat history & training」をオフに設定

-

「この設定では会話は保存されません」と表示されれば完了

✅ ログの確認と削除方法

ChatGPTには過去のチャット履歴が保存される仕組みがあります。不要な履歴は以下の手順で削除可能です。

ログ確認・削除の流れ:

-

サイドメニューの過去の会話を選択

-

各チャット右の「・・・」をクリックして「削除」

-

一括削除も「Settings > Data Controls」から実行可能

仕事や学校などで複数人が使う端末では、ログの削除を習慣化しておくと安心です。

✅ 自動ログ保存が心配な場合は「シークレットモード」も

どうしても履歴を残したくない場合は、ブラウザのシークレットモード(プライベートモード)を使えば、ローカルにも記録が残りません。

Chromeなら Ctrl+Shift+N、Safariなら Command+Shift+N で起動できます。

ChatGPT以外での「安全なAI活用」選択肢とは?

ChatGPTは便利な一方、「質問内容がバレるかもしれない」という懸念を払拭できない方も多いでしょう。

そんな方のために、より高いセキュリティやカスタマイズ性を重視した代替ツールも多数存在します。

✅ 安全性重視なら「ローカル実行型AI」

完全オフラインで使えるAIツールは、ネットに接続されないため、情報漏洩リスクがほぼゼロ。

| ツール名 | 特徴 | 主な用途 |

|---|---|---|

| LM Studio | ChatGPTのようなローカル推論環境 | コーディング、文章生成など |

| GPT4All(Nomic社) | 軽量でPCに直接インストール可能 | 個人用Q&A/文書作成 |

| Ollama | GUI付きで操作しやすい | 自宅での安心活用 |

💡専門知識が不要なGUI付きのツールを選ぶと、初心者にも扱いやすいです。

✅ 教育機関・法人向けには「専用プラットフォーム」

ChatGPT APIのように学習にデータを使わない商用ライセンスや、教育現場専用のAIも登場しています。

-

Microsoft Copilot(企業・教育機関向け)

→ Microsoft 365連携。組織単位で利用ポリシー設定可能。 -

ClassPoint AI/Rinna(日本語特化AI)

→ 教育現場に最適化され、学生データも保護されやすい設計。

✅ プライバシー特化型のチャットAI

-

PrivateGPT(ローカル環境限定):完全非通信型。個人データの扱いも安心。

-

Claude(Anthropic社):プライバシー保護設計が明確で企業導入実績も多数。

🔐「安心して聞ける環境」を選ぶことが第一歩

AIとの対話は、内容によっては「仕事・学業・生活」の重要な情報に直結します。そのため、自分が何を求め、どこまでの安全性が必要かを見極めたうえで、最適なAIツールを選ぶことが重要です。

AIに“聞いてはいけない”質問とは?漏洩しやすい情報例

どんなに便利なAIツールであっても、入力してはいけない情報があります。

特にChatGPTのような生成AIは、「質問内容」が外部で扱われる可能性があるため、センシティブな情報は慎重に扱う必要があります。

❌ 入力NGな情報の代表例【漏洩リスク大】

| 情報の種類 | 具体例 | なぜ危険か |

|---|---|---|

| 氏名・住所・電話番号などの個人情報 | 自分や他人の名前、番号、住所 | データベースに残る可能性があり、悪用リスクも |

| 社外秘・契約書などの業務機密 | 未公開資料、開発中サービス内容 | 社内ガイドライン違反で処分対象になることも |

| 学業の課題・試験問題そのもの | レポート・論述課題の全文 | 不正利用とみなされ、評価に影響する可能性あり |

| クレジットカード番号・パスワード | 認証情報、マイナンバーなど | 不正アクセスや情報流出の直接原因になる |

| 相談内容としてデリケートな話題 | 心理的相談、医療情報、家族事情など | 本人の意図を超えて扱われる懸念もある |

💡「これ入力して大丈夫?」の基準は“社外に話せるか”

AIに質問する前に、「この内容を社外の人に口頭で話せるか?」を基準に判断すると、入力の安全性が高まります。

また、文章を要約したり匿名化してから入力するなど、リスクを減らす工夫も大切です。

🔐 誤って入力してしまったら?対応策はこちら

-

履歴の削除(ChatGPTの設定画面から可能)

-

フィードバック機能で削除依頼

-

社内ルールがある場合はすぐに報告

※OpenAIでは、2025年時点で「一部データを学習に使用しない」設定が可能ですが、それでも完全な削除保証はありません。

2025年以降のChatGPT利用とプライバシー対策の方向性

2025年現在、ChatGPTをはじめとする生成AIは日常・教育・ビジネスの現場に深く浸透しています。

一方で、「質問内容がバレるのでは?」「情報漏洩が心配」といった声は依然多く、プライバシー保護と利便性のバランスが課題となっています。

🔄 OpenAIの対応:今後も進化が加速する

OpenAIは2024年末にかけて以下のようなユーザー保護機能の拡充を発表・実施しています。

-

チャット履歴の完全無効化

-

一時的な会話(Temporary Chat)モードの導入

-

ビジネス向けアカウントでは学習対象から除外(ChatGPT Team / Enterprise)

これにより、2025年以降はユーザーがより明確に「何を残す/残さないか」選べる時代に向かっています。

🔐 プライバシー保護で今後主流になる対策【予測】

| 施策 | 期待される効果 |

|---|---|

| ユーザー側で履歴管理を細かく設定できる機能 | セキュリティ意識の高い現場でのAI導入促進 |

| 業務利用では社内AIの自社ホスティング型が主流に | 情報漏洩リスクを極小化できる |

| AIが質問のリスクを自動検知し、注意喚起する機能 | うっかり機密入力の抑止につながる |

| プライバシー強化ツール(拡張機能)の一般化 | 一般ユーザーでも高度な情報管理が可能に |

💡 安全に使うために「学ぶ姿勢」が問われる時代へ

技術が進化しても、最後に安全を守るのは“使う人のリテラシー”です。

特に2025年以降、生成AIを仕事や学習で活用するためには「情報管理力」「ツール理解」「責任ある使い方」が不可欠になります。

便利だから使うのではなく、安心して使えるよう“備える”こと。

それがこれからのAI時代に求められる姿勢です。

ChatGPTで質問内容はバレる?情報漏洩の危険性と安全な使い方【2025年版】のまとめ

-

ChatGPTに入力した内容は、設定次第でOpenAIの学習に利用される可能性がある

-

「質問内容がバレる」と感じる要因には、誤解や生成AIの精度も影響している

-

高校などの教育現場では、利用制限や検出ツールによる判定が行われている

-

チャット履歴は自動保存されるが、無効化や削除設定も可能

-

AI判定ツール(いわゆる「バレるサイト」)の精度には限界がある

-

個人情報を誤って入力した場合は、すぐに履歴削除とパスワード変更を行うこと

-

情報漏洩のリスクを防ぐには、利用時の設定確認と適切な使い方が不可欠

-

企業では業務データの取り扱いに注意が必要で、社内規定の確認が必須

-

プログラミングの質問でも、機密情報やコード全体のコピー貼り付けには注意

-

今後は「情報を守る使い方」を学ぶことがAI活用の前提になる

【本記事の関連ハッシュタグ】